ASR: O que é Automatic Speech Recognition?

Automatic Speech Recognition (ASR) é o processo de conversão automática de fala em texto. As tecnologias de ASR utilizam métodos de aprendizado de máquina para analisar e processar padrões de fala, transformando-os em texto. O Automatic Speech Recognition pode ser encontrado hoje em assistentes virtuais, além de ser usado para a geração de legendas em vídeos e a transcrição de reuniões.

O que significa Automatic Speech Recognition?

Automatic Speech Recognition, em português “reconhecimento automático de fala”, é um subcampo da informática e da linguística computacional. Ele se concentra no desenvolvimento de métodos para converter automaticamente a fala em textos legíveis por máquinas. O processo de conversão de fala em texto é chamado de Speech-to-Text (STT). Processos de ASR são baseados em modelos estatísticos e algoritmos complexos.

A precisão de um sistema ASR é medida pela taxa de erro de palavras (WER). Essa taxa relaciona o número de erros – palavras omitidas, adicionadas ou reconhecidas incorretamente – ao número total de palavras faladas. Quanto menor a taxa de erro, maior a precisão do reconhecimento automático de fala. Por exemplo, se a WER for de 10%, a transcrição terá uma precisão de 90%.

Como funciona o Automatic Speech Recognition?

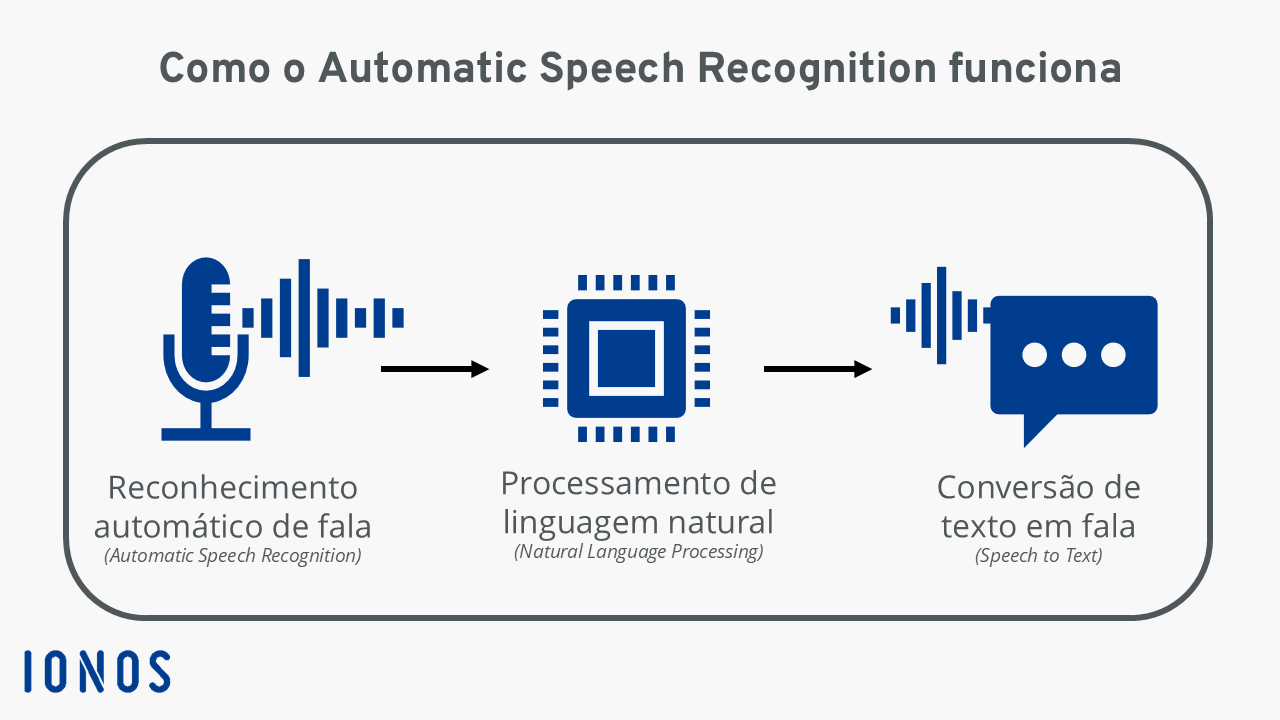

O Automatic Speech Recognition é composto por várias etapas interligadas, que são descritas a seguir:

- Reconhecimento automático de fala (Automatic Speech Recognition): O sistema capta a fala através de um microfone ou outra fonte de áudio.

- Processamento de linguagem natural (Natural Language Processing): O primeiro processo consiste em limpar os ruídos da gravação. Um algoritmo analisa as propriedades fonéticas e fonêmicas da fala, comparando-as com modelos treinados para identificar palavras.

- Conversão de fala em texto (Speech to Text): O sistema converte os sons reconhecidos em texto.

Algoritmos de ASR: Abordagem híbrida vs. deep learning

Existem basicamente duas abordagens principais para o Automatic Speech Recognition (ASR): enquanto no passado eram utilizados principalmente métodos híbridos clássicos, como os modelos ocultos de Markov, atualmente há um aumento no uso de tecnologias de deep learning. Essa mudança se deve ao fato de que a precisão dos modelos tradicionais estagnou nos últimos tempos.

Abordagem híbrida clássica

Modelos clássicos exigem dados alinhados de forma forçada. Isso significa que eles utilizam a transcrição de texto de um segmento de áudio para determinar onde determinadas palavras aparecem. A abordagem híbrida tradicional combina sempre um modelo de léxico, um modelo acústico e um modelo de linguagem para transcrever a fala:

- O modelo de lexicon define a pronúncia fonética das palavras. É necessário criar um conjunto de dados ou fonemas para cada idioma.

- O modelo acústico visa modelar os padrões acústicos da fala. Usando os dados alinhados, ele faz previsões sobre qual som ou fonema se associa a diferentes segmentos de fala.

- O modelo de linguagem aprende quais sequências de palavras são mais prováveis em um idioma. Sua tarefa é prever quais palavras têm mais probabilidade de seguir as palavras atuais.

A principal desvantagem da abordagem híbrida é a dificuldade em aumentar a precisão do reconhecimento de fala usando esse método. Além disso, há a necessidade de treinar três modelos separados, o que pode ser muito demorado e custoso. No entanto, como já existe um conhecimento amplo sobre como criar um modelo robusto usando a abordagem clássica, muitas empresas ainda optam por essa opção.

Deep Learning com processos end-to-end

Sistemas end-to-end têm a capacidade de transcrever diretamente uma sequência de características acústicas de entrada. Como as palavras faladas devem ser convertidas, o algoritmo aprende isso usando uma grande quantidade de pares de dados na forma de arquivos de áudio de uma frase específica e sua transcrição correta.

Arquiteturas de Deep Learning como CTC, LAS e RNNT podem ser treinadas para fornecer resultados precisos mesmo sem dados forçados alinhados, modelo de léxico e modelo de linguagem. No entanto, muitos sistemas de deep learning ainda são conectados a um modelo de linguagem, pois este pode ajudar a aumentar ainda mais a precisão da transcrição.

No nosso artigo comparativo entre deep learning e machine learning, você encontrará as diferenças entre os dois conceitos.

A abordagem end-to-end para Automatic Speech Recognition não apenas oferece maior precisão do que modelos convencionais. Além disso, os sistemas de ASR são mais fáceis de treinar e requerem menos trabalho humano.

Principais campos de aplicação do Automatic Speech Recognition

Graças principalmente aos avanços na área de machine learning, as tecnologias de ASR estão se tornando cada vez mais precisas e poderosas. O Automatic Speech Recognition pode ser aplicado em muitas indústrias para aumentar a eficiência, melhorar a satisfação do cliente e/ou aumentar o retorno sobre o investimento (ROI). Os principais campos de aplicação incluem:

- Telecomunicações: Os centros de contato utilizam tecnologias de ASR para transcrever e analisar conversas com clientes. Transcrições precisas também são necessárias para o rastreamento de chamadas e soluções telefônicas realizadas por meio de servidores em nuvem.

- Plataformas de Vídeo: Atualmente, a criação de legendas em tempo real em plataformas de vídeo é considerada um padrão da indústria. O Automatic Speech Recognition também é útil para a categorização de conteúdo.

- Monitoramento de Mídia: APIs de ASR permitem analisar programas de TV, podcasts, transmissões de rádio e outras mídias para verificar com que frequência determinadas marcas ou tópicos são mencionados.

- Videoconferências: Soluções de reuniões como Zoom, Microsoft Teams ou Google Meet dependem de transcrições precisas e da análise desse conteúdo para obter insights e tomar decisões apropriadas. O Automatic Speech Recognition também pode ser usado para fornecer legendas ao vivo durante videoconferências.

- Assistentes de voz: Seja a Alexa da Amazon, o Google Assistant ou a Siri da Apple, assistentes de voz virtuais são baseados em Automatic Speech Recognition. A tecnologia permite que os assistentes respondam a perguntas, realizem tarefas e interajam com outros dispositivos.

Qual é o papel da inteligência artificial nas tecnologias de ASR?

A inteligência artificial (IA) ajuda a melhorar a precisão e a funcionalidade geral dos sistemas de ASR. Em particular, o desenvolvimento de grandes modelos de linguagem fez com que a linguagem natural pudesse ser processada de forma significativamente melhor atualmente. Um Large Language Model não apenas consegue criar textos complexos com alta relevância e realizar traduções, mas também reconhece a fala. Portanto, os sistemas de ASR se beneficiam enormemente dos avanços nessa área. Além disso, a inteligência artificial também é útil no desenvolvimento de modelos de linguagem específicos para sotaques.

Quais são os pontos fortes e fracos da tecnologia de ASR?

Comparado à transcrição tradicional, o Automatic Speech Recognition oferece algumas vantagens. Uma das principais forças dos métodos modernos de ASR é sua alta precisão, que resulta do treinamento de sistemas com grandes volumes de dados. Isso permite melhorar a qualidade de legendas ou transcrições e disponibilizá-las em tempo real.

Outra vantagem importante é o aumento da eficiência. O Automatic Speech Recognition permite que as empresas escalem, ampliem rapidamente sua gama de serviços e ofereçam isso a um público maior. Para estudantes e profissionais, ferramentas de reconhecimento de voz automático facilitam a documentação de conteúdos de áudio – como reuniões de negócios ou palestras universitárias.

Por outro lado, a desvantagem é que, embora os sistemas de ASR sejam mais precisos do que nunca, ainda não alcançam a precisão dos humanos. Isso se deve principalmente às inúmeras nuances da fala. Desafios incluem sotaques, dialetos e diferentes tons de voz, além de ruídos de fundo. Mesmo os modelos de deep learning mais avançados não conseguem cobrir todos os casos especiais. Outro ponto problemático é que as tecnologias de ASR podem processar dados pessoais, levantando preocupações sobre segurança de dados e privacidade.